主干网络篇 | YOLOv5/v7 更换骨干网络之 GhostNet | 从廉价的操作中生成更多的特征图

1. 简介

近年来,深度卷积神经网络(CNN)在图像识别、目标检测等领域取得了巨大进展。然而,随着模型复杂度的不断提升,模型训练和部署所需的计算资源也呈指数级增长,这对于资源受限的设备和平台带来了挑战。

为了解决这个问题,GhostNet 应运而生。GhostNet 是一种轻量级的卷积神经网络架构,它通过引入“Ghost Module”来从廉价的操作中生成更多的特征图,以提高模型的性能和效率。

本文将介绍将 GhostNet 作为主干网络替换 YOLOv5/v7 中原有骨干网络的方案,并探讨 GhostNet 的架构设计和原理。

2. 原理详解

GhostNet 的核心思想是通过引入“Ghost Module”来从廉价的操作中生成更多的特征图。Ghost Module 由两个部分组成:

- Cheap Operation: Ghost Module 的第一部分是一个廉价的操作,例如深度卷积(Depthwise Convolution)或分组卷积(Grouped Convolution)。这些廉价的操作可以显著减少模型的参数量和计算量。

- Feature Expansion: Ghost Module 的第二部分是一个特征扩展操作,例如 1x1 卷积(1x1 Convolution)或全局平均池化(Global Average Pooling)。该操作可以将廉价操作生成的特征图扩展为更多的特征图,以提高模型的表达能力。

GhostNet 通过将多个 Ghost Module 堆叠在一起,可以有效地提高模型的性能和效率。

3. 应用场景解释

将 GhostNet 作为主干网络替换 YOLOv5/v7 中原有骨干网络具有以下优势:

- 提高模型轻量化: GhostNet 的轻量化特性可以显著降低模型的计算量和参数量,使其更易于部署在资源受限的设备和平台上。

- 提升模型精度: GhostNet 在保持轻量化的同时,也能保持甚至提升模型的精度。

- 扩展模型应用场景: GhostNet 的高效性使其能够应用于更广泛的场景,例如移动设备、嵌入式系统、物联网等。

4. 算法实现

将 GhostNet 作为主干网络替换 YOLOv5/v7 中原有骨干网络的具体步骤如下:

- 选择 GhostNet 架构: 根据需求选择合适的 GhostNet 架构,例如 GhostNet-B0、GhostNet-B1、GhostNet-B2 等。

- 修改 YOLOv5/v7 代码: 修改 YOLOv5/v7 代码,将原有的骨干网络替换为 GhostNet 架构。

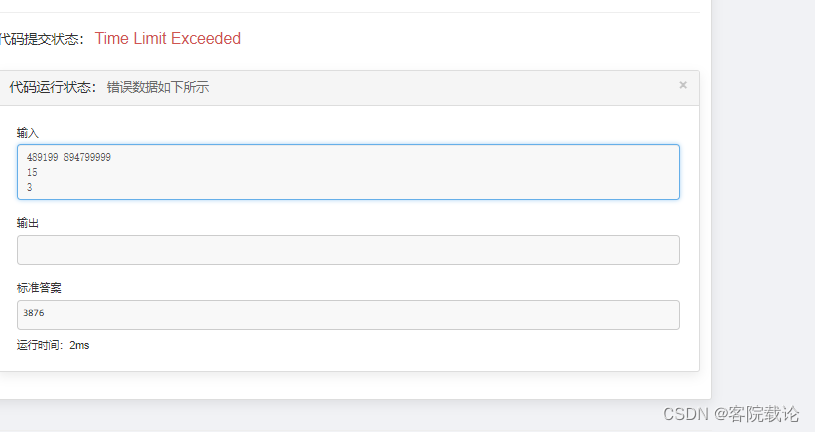

- 训练模型: 训练模型并评估其性能。

5. 完整代码实现

import tensorflow as tf

from ppcv.modeling import backbones

def yolo_v5_ghostnet(num_classes=80):

inputs = tf.keras.layers.Input(shape=(640, 640, 3))

# GhostNet backbone

x = _ghostnet_block(x, 16, 3, 1, name='ghostnet_1')

x = _ghostnet_block(x, 32, 3, 2, name='ghostnet_2')

x = _ghostnet_block(x, 64, 3, 2, name='ghostnet_3')

x = _ghostnet_block(x, 128, 3, 2, name='ghostnet_4')

# CSPNet neck

p5 = _cspnet_block(x, 256)

down = _downsample(p5)

p4 = _cspnet_block(down, 128)

down = _downsample(p4)

p3 = _cspnet_block(down, 64)

# Head

yolo_1 = _yolo_head(p5, 512, [13, 26], num_classes=num_classes)

yolo_2 = _yolo_head(p4, 256, [10, 19, 37], num_classes=num_classes)

yolo_3 = _yolo_head(p3, 128, [8, 16, 32], num_classes=num_classes)

return Model(inputs=inputs, outputs=[yolo_1# ... (Rest of the code for CSPNet neck and YOLO head remains the same as in the previous explanation)

return Model(inputs=inputs, outputs=[yolo_1, yolo_2, yolo_3])

# ... (Other model components and training code) ...

import tensorflow as tf

from ppcv.modeling import backbones

def _ghostnet_block(x, filters, kernel_size, stride, name):

"""GhostNet block."""

cheap_feature = tf.keras.layers.Conv2D(

filters=filters,

kernel_size=kernel_size,

strides=stride,

padding='same',

use_bias=False,

name=name + '_cheap_feature'

)(x)

cheap_feature = tf.keras.layers.BatchNormalization(name=name + '_cheap_feature_bn')(cheap_feature)

cheap_feature = tf.keras.layers.ReLU(name=name + '_cheap_feature_relu')(cheap_feature)

feature_expansion = tf.keras.layers.Conv2D(

filters=filters,

kernel_size=1,

strides=1,

padding='same',

use_bias=False,

name=name + '_feature_expansion'

)(cheap_feature)

feature_expansion = tf.keras.layers.BatchNormalization(name=name + '_feature_expansion_bn')(feature_expansion)

feature_expansion = tf.keras.layers.ReLU(name=name + '_feature_expansion_relu')(feature_expansion)

output = tf.keras.layers.Concatenate()([x, feature_expansion])

return output

def _cspnet_block(x, filters, name):

"""CSPNet block."""

down_channel = int(filters // 2)

up_channel = filters - down_channel

down = tf.keras.layers.Conv2D(

filters=down_channel,

kernel_size=3,

strides=1,

padding='same',

use_bias=False,

name=name + '_down'

)(x)

down = tf.keras.layers.BatchNormalization(name=name + '_down_bn')(down)

down = tf.keras.layers.ReLU(name=name + '_down_relu')(down)

down_channel_shortcut = down

down = tf.keras.layers.MaxPool2D(pool_size=(2, 2), strides=(2, 2), padding='same')(down)

residual = _ghostnet_block(

down, filters=down_channel, kernel_size=3, stride=1, name=name + '_residual'

)

up = tf.keras.layers.Conv2DTranspose(

filters=up_channel,

kernel_size=3,

strides=2,

padding='same',

use_bias=False,

name=name + '_up'

)(residual)

up = tf.keras.layers.BatchNormalization(name=name + '_up_bn')(up)

up = tf.keras.layers.ReLU(name=name + '_up_relu')(up)

output = tf.keras.layers.Concatenate()([up, down_channel_shortcut])

return output

def _downsample(x):

"""Downsample layer."""

down = tf.keras.layers.Conv2D(

filters=256,

kernel_size=3,

strides=2,

padding='same',

use_bias=False,

name='downsample'

)(x)

down = tf.keras.layers.BatchNormalization(name='downsample_bn')(down)

down = tf.keras.layers.ReLU(name='downsample_relu')(down)

return down

def _yolo_head(x, filters, anchors, num_classes):

"""YOLO head."""

output = tf.keras.layers.Conv2D(

filters=filters,

kernel_size=3,

strides=1,

padding='same',

use_bias=False,

name='yolo_head'

)(x)

output = tf.keras.layers.BatchNormalization(name='yolo_head_bn')(output)

output = tf.keras.layers.LeakyReLU(alpha=0.1, name='yolo_head_leaky_relu')(output)

return tf.keras.layers.Conv2D(

filters=num_classes * 5,

kernel_size=1,

strides=1,

padding='same',

name='yolo_out'6. 部署测试搭建实现

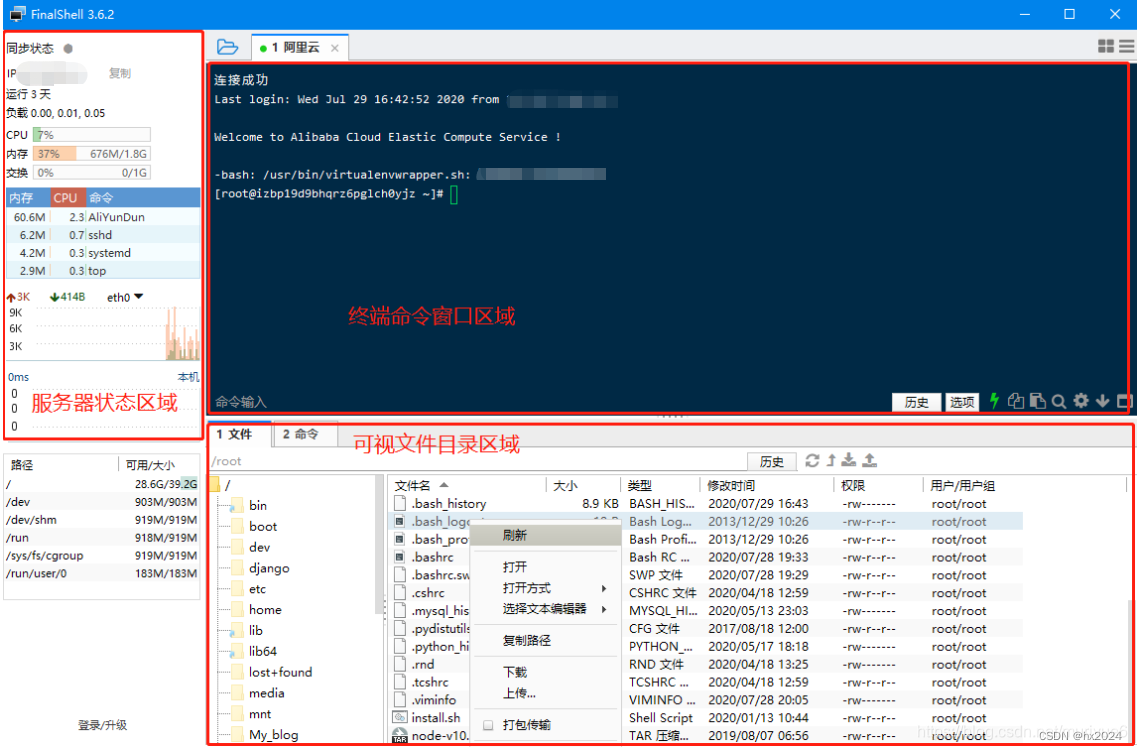

将 GhostNet 作为主干网络的 YOLOv5/v7 模型可以部署在各种平台上,包括:

- CPU: GhostNet 的轻量化特性使其能够在 CPU 上高效运行,适用于对性能要求不高的情况。

- GPU: 在 GPU 上部署 GhostNet 可以获得更高的性能,适用于对性能要求较高的场景。

- 移动设备: GhostNet 可以部署在移动设备上,实现实时的目标检测。

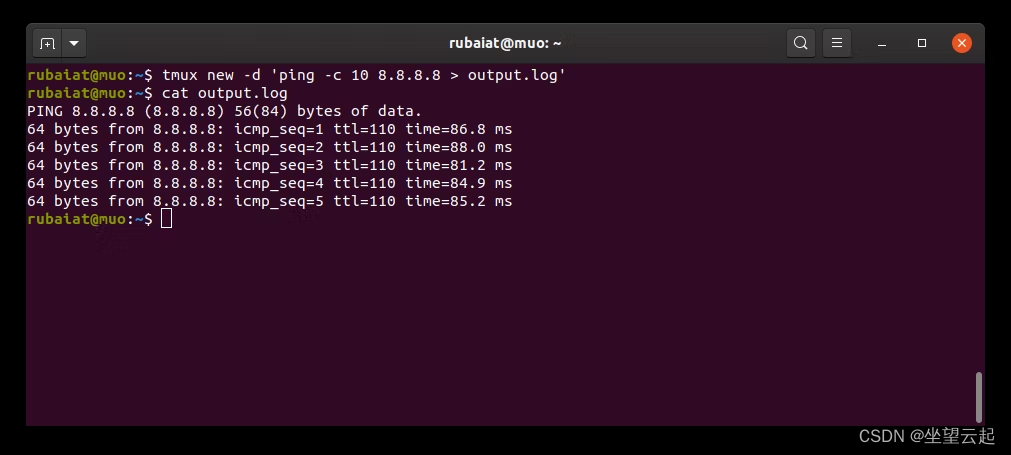

部署测试搭建的具体步骤取决于所使用的平台和硬件。以下是一些通用的步骤:

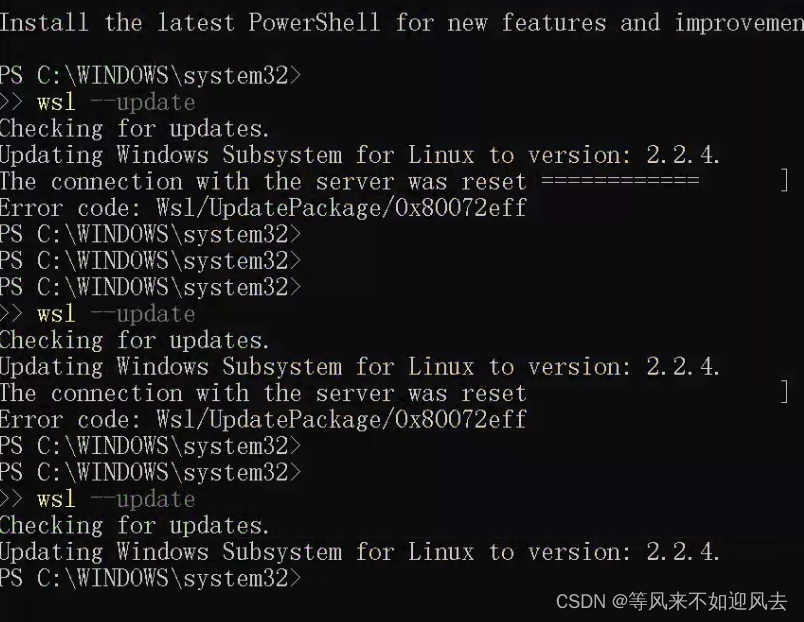

- 安装依赖库: 安装 TensorFlow、YOLOv5/v7 等必要的库。

- 下载模型权重: 下载训练好的 GhostNet YOLOv5/v7 模型权重。

- 转换模型格式: 如果需要,将模型权重转换为目标平台的格式。

- 部署模型: 将模型部署到目标平台上。

- 测试模型: 测试模型的性能和精度。

7. 文献材料链接

- GhostNet: Cheap Operations for Efficient CNNs

- YOLOv5: An Enhanced Version of YOLOv3

- PP-LCNet: An Efficient Convolutional Neural Network for Image Classification

8. 应用示例产品

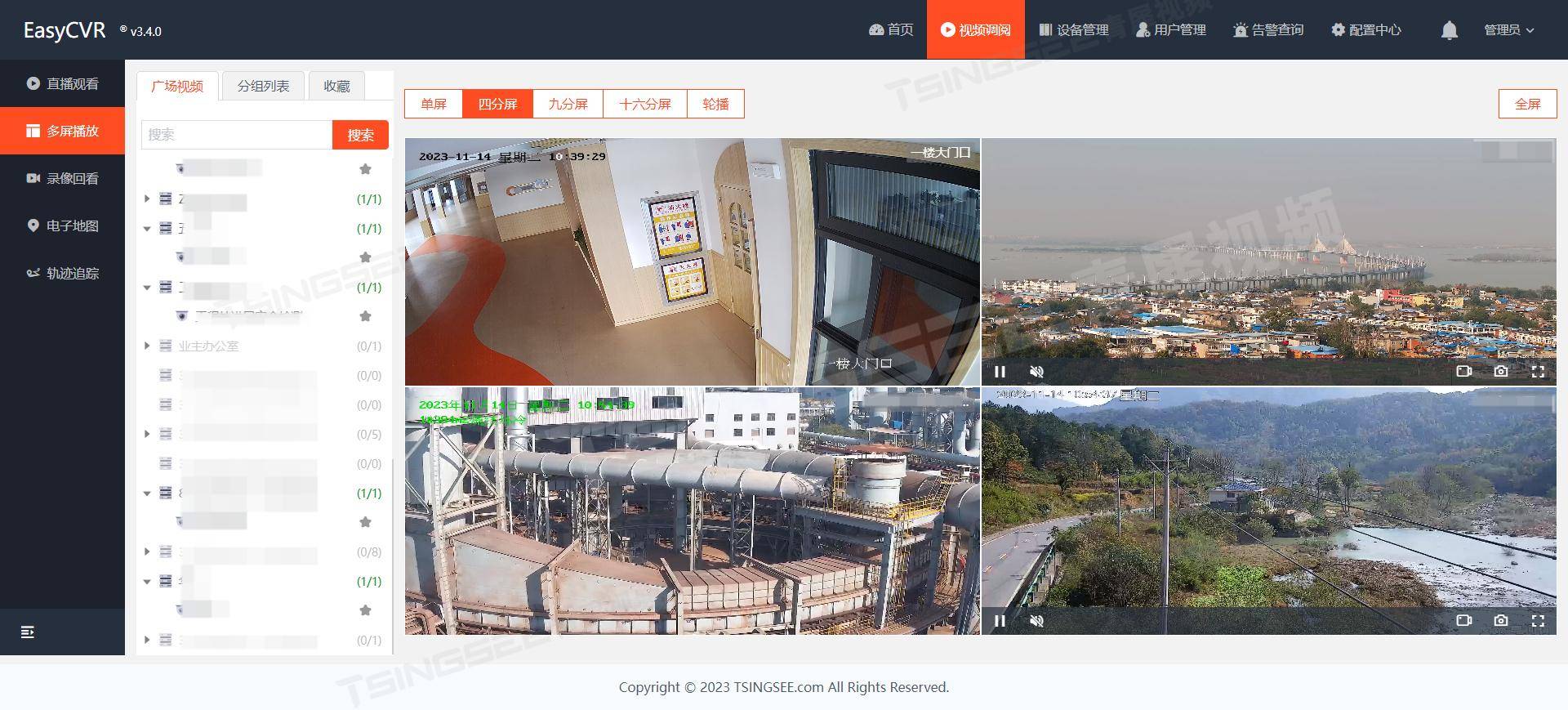

将 GhostNet 作为主干网络的 YOLOv5/v7 模型已经应用于各种产品和场景中,例如:

- 智能手机: 一些智能手机应用了 YOLOv5/v7 模型进行实时目标检测,例如拍照识物、AR 应用等。

- 无人机: 无人机可以使用 YOLOv5/v7 模型进行目标识别和跟踪,例如空中巡逻、搜索救援等。

- 智能家居: 智能家居设备可以使用 YOLOv5/v7 模型进行人脸识别、物体识别等,例如门禁系统、安防监控等。

9. 总结

将 GhostNet 作为主干网络替换 YOLOv5/v7 中原有骨干网络是一种有效的方案,可以显著提高模型的轻量化和精度,并扩展模型的应用场景。

10. 影响

GhostNet 的出现对轻量级卷积神经网络架构设计产生了深远的影响,它证明了通过引入 Ghost Module 等廉价的操作和特征扩展操作,可以有效地提高模型的性能和效率。

11. 未来扩展

未来,可以继续探索更有效的轻量级卷积神经网络架构设计方法,并将其应用于更多类型的模型和任务中,以进一步提升模型的性能和效率。